Redis持久化

RDB快照(snapshot)

在默认情况下, Redis 将内存数据库快照保存在名字为 dump.rdb 的二进制文件中。 你可以对 Redis 进行设置, 让它在“ N 秒内数据集至少有 M 个改动”

这一条件被满足时, 自动保存一次 数据集。 比如说, 以下设置会让 Redis 在满足“ 60 秒内有至少有 1000 个键被改动”这一条件时, 自动保存一次 数据

集: # save 60 1000 //关闭RDB只需要将所有的save保存策略注释掉即可

还可以手动执行命令生成RDB快照,进入redis客户端执行命令save或bgsave可以生成dump.rdb文件, 每次命令执行都会将所有redis内存快照到一个新的rdb

文件里,并覆盖原有rdb快照文件。

bgsave的写时复制(COW)机制

Redis 借助操作系统提供的写时复制技术(Copy-On-Write, COW),在生成快照的同时,依然可以正常 处理写命令。简单来说,bgsave 子进程是由主线程

fork 生成的,可以共享主线程的所有内存数据。 bgsave 子进程运行后,开始读取主线程的内存数据,并把它们写入 RDB 文件。此时,如果主线程对这些 数

据也都是读操作,那么,主线程和 bgsave 子进程相互不影响。但是,如果主线程要修改一块数据,那 么,这块数据就会被复制一份,生成该数据的副本。然后,

bgsave 子进程会把这个副本数据写入 RDB 文 件,而在这个过程中,主线程仍然可以直接修改原来的数据。

save与bgsave对比

| 命令 | save | bgsave |

|---|---|---|

| IO类型 | 同步 | 异步 |

| 是否阻塞redis其他命令 | 是 | 否(在生成子进程执行调用fork函数时会有短期阻塞) |

| 复杂度 | O(n) | O(n) |

| 有点 | 不会消耗额外内存 | 不阻塞客户端命令 |

| 缺点 | 阻塞客户端命令 | 需要fork子进程,消耗内存 |

配置自动生成rdb文件后台使用的是bgsave方式。

- AOF (append-only file)

快照功能并不是非常耐久(durable):如果redis因为某些原因造成故障停机,那么服务器将丢失最近写入、且未保存到快照的那些数据。从1.1版开始

Redis增加了一种完全耐久的持久化方式:AOF持久化,将修改的每一条指令记录进文件appendonly.aof中(先写入os cache,每隔一段时间fsync到

磁盘)

比如执行命令 “set littlehui 666” ,aof记录如下

1 | *3 |

这种是resp协议格式数据,星号后面的数字代表命令有多少个参数。$号后面的数字代表这个参数有几个字符。

PS:如果执行带过期的set命令,aof文件记录的并不是原始命令。而是记录这个key的过期时间戳。

比如执行 “set littlehui 888 ex 1000” aof记录如下

1 | *3 |

AOF功能开启:

1 | appendonly yes |

redis重启时,程序通过执行AOF的命令来进行重加数据集。

通过配置修改fsync到磁盘的频次。

1 | appendfsync always:每次有新命令追加到 AOF 文件时就执行一次 fsync ,非常慢,也非常安全。 |

以上配置为推荐值,可以兼顾速度和安全性。

- AOF重写

AOF文件里可能有太多没用指令,所以AOF会定期根据内存的新数据生成aof文件。

例如:重写后AOF变成1

2

3

4127.0.0.1:6379>incr readcount

(Integer)1

127.0.0.1:6379>incr readcount

(Integer)21

2

3

4

5

6

7*3

3

set

2

readcount

1

2

自动重写频率

1 | auto‐aof‐rewrite‐min‐size 64mb //aof文件至少要达到64M才会自动重写,文件太小恢复速度本来就 很快,重写的意义不大 |

| 命令 | RDB | AOF |

|---|---|---|

| 启动优先级 | 低 | 高 |

| 体积 | 小 | 大 |

| 恢复速度 | 快 | 慢 |

| 数据安全性 | 容易丢数据 | 根据策略决定 |

生产环境可以都启用,redis启动时如果既有rdb文件又有aof文件则优先选择aof文件恢复数据,因为aof 一般来说数据更全一点。

Redis 4.0混合持久化

重启 Redis 时,我们很少使用 RDB来恢复内存状态,因为会丢失大量数据。我们通常使用 AOF 日志重 放,但是重放 AOF 日志性能相对 RDB来说要慢很多,这样在 Redis 实例很大的情况下,启动需要花费很 长的时间。 Redis 4.0 为了解决这个问题,带来了一个新的持久化选项——混合持久化。 通过如下配置可以开启混合持久化(必须先开启aof):

1 | aof-use-rdb-preamble yes |

如果开启了混合持久化,AOF在重写时,不再是单纯将内存数据转换为RESP命令写入AOF文件,而是将 重写这一刻之前的内存做RDB快照处理,并且将RDB快照内容和增量的AOF修改内存数据的命令存在一 起,都写入新的AOF文件,新的文件一开始不叫appendonly.aof,等到重写完新的AOF文件才会进行改 名,覆盖原有的AOF文件,完成新旧两个AOF文件的替换。 于是在 Redis 重启的时候,可以先加载 RDB 的内容,然后再重放增量 AOF 日志就可以完全替代之前的 AOF 全量文件重放,因此重启效率大幅得到提升。

混合持久化AOF文件结构

- Redis数据备份策略

- 写crontab定时调度脚本,每小时都copy一份rdb或aof备份到一个目录中去,仅仅保留最近48小时的备份。

- 每天都保留一份当日的数据备份到一个目录中去,可以保留最近1个月的备份。

- 每次copy留备份的时候,都把太旧的备份给删了。

- 每天晚上将当前机器上的备份复制一份到其他机器上,以防机器损坏。

主从架构

** redis主从架构搭建,配置从节点步骤 **

1 | 1、复制一份redis.conf文件 |

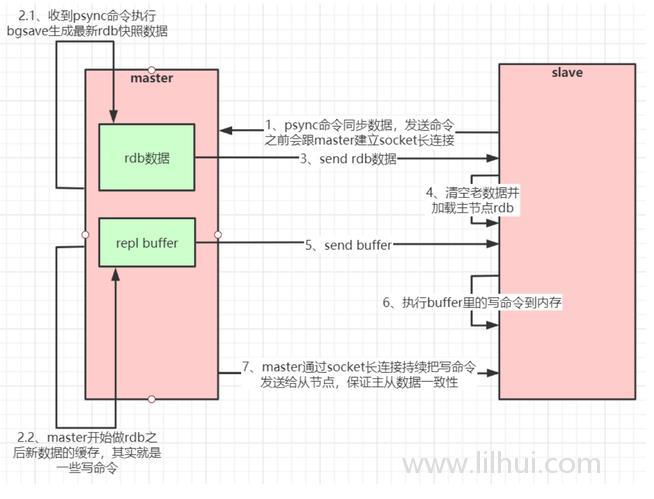

Redis主从工作原理

如果你为master配置了一个slave,不管这个slave是否是第一次连上Master,都会发送一个PSYNC命令给master请求复制数据。

master收到PSYNC命令后,会再后台进行数据持久化通过bgsave生成最新的rdb快照文件,持久化期间,master会继续接收客户端

的请求,它会把这些可能修改数据集的请求缓存在内存中。当持久化进行完毕后,master会把这份rdb文件数据集发送给slave,slave

会把接收到的数据进行持久化生成rdb,然后加载到内存中。最后master再将之前缓存在内存中的命令发送给slave.

当master与slave之间的链接由于某些原因而断开时,slave能够自动重连Master,如果master收到了多个slave并发链接请求,它

只会进行一次持久化,而不是一个连接一次,然后再把这一份持久化的数据发送给多个并发连接的slave.

- 主从复制(全量复制)流程图

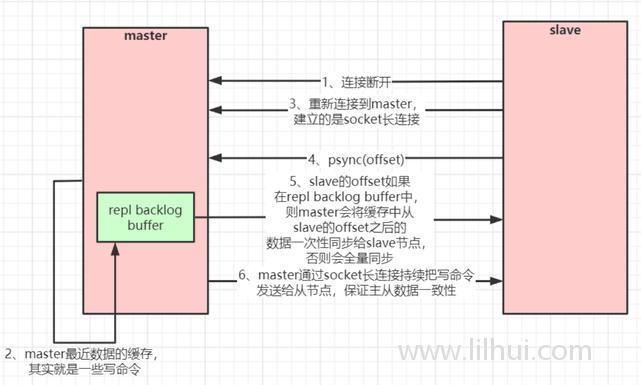

- 数据部分复制

当master和slave断开重连后,一般会对整个数据进行复制。但从redis2.8版开始,redis改用可以支持部分数据复制的命令PSYNC

去master同步数据,slave和master能够在网络连接断开重连后进行部分数据复制(断点续传)

master会再其内存中创建一个复制数据用的缓存队列,缓存最近一段时间的数据,master和它所有的slave都维护了复制数据下表offset

和master的进程ID,因此,当网络连接断开后,slave会请求master offset太久,已经补在master的缓存队列里了。那么将会进行一次

全量数据的复制。

- 主从断点续传流程图

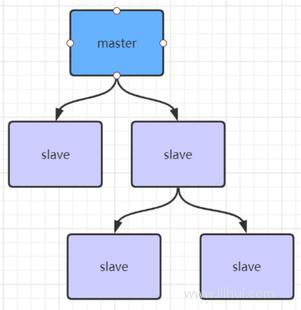

如果有很多从节点,为了环节主从复制风暴(多个节点同时复制主节点导致主节点压力过大可以做一下架构,让部分从节点与从节点同步数据。

Redis管道与Lua脚本

管道(pipeline)

客户端可以一次性发送多个请求而不用等待服务器的响应,待所有命令都发送完后再一次性读取服务的响应,这样可以极大的降低多条命令执行的网络传输开销,管道执行多条命令的网络开销实际上只相当于一次命令执行的网络开销。需要注意到是用pipeline方式打包命令发送,redis必须在处理完所有命令前先缓存起所有命令的处理结果。打包的命令越多,缓存消耗内存也越多。所以并不是打包的命令越多越好。

pipeline中发送的每个command都会被server立即执行,如果执行失败,将会在此后的响应中得到信

息;也就是pipeline并不是表达“所有command都一起成功”的语义,管道中前面命令失败,后面命令不会有影响,继续执行。

1 | Pipeline pl = jedis.pipelined(); |

Redis Lua脚本

Redis在2.6推出了脚本功能,允许开发者使用Lua语言编写脚本传到Redis中执行。使用脚本的好处如下:

1、减少网络开销:本来5次网络请求的操作,可以用一个请求完成,原先5次请求的逻辑放在redis服务器上完成。使用脚本,减少了网络往返时延。这点跟管道类似。

2、原子操作:Redis会将整个脚本作为一个整体执行,中间不会被其他命令插入。管道不是原子的,不过redis的批量操作命令(类似mset)是原子的。

3、替代redis的事务功能:redis自带的事务功能很鸡肋,而redis的lua脚本几乎实现了常规的事务功能,官方推荐如果要使用redis的事务功能可以用redis lua替代。

官网文档上有这样一段话:

1 | A Redis script is transactional by definition, so everything you can do with a Redis t ransaction, you can also do with a script, |

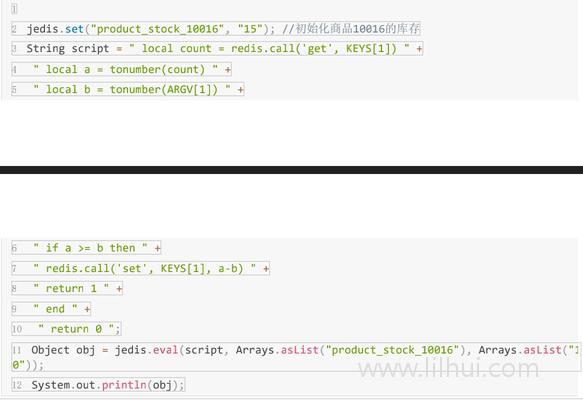

从Redis2.6.0版本开始,通过内置的Lua解释器,可以使用EVAL命令对Lua脚本进行求值。EVAL命令的格式如下:

1 | EVAL script numkeys key [key ...] arg [arg ...] |

script参数是一段Lua脚本程序,它会被运行在Redis服务器上下文中,这段脚本不必(也不应该)定义为一个Lua函数。numkeys参数用于指定键名参数的个数。键名参数 key [key …] 从EVAL的第三个参数开始算起,表示在脚本中所用到的那些Redis键(key),这些键名参数可以在 Lua中通过全局变量KEYS数组,用1 为基址的形式访问( KEYS[1] , KEYS[2] ,以此类推)。

在命令的最后,那些不是键名参数的附加参数 arg [arg …] ,可以在Lua中通过全局变量ARGV数组访问,访问的形式和KEYS变量类似( ARGV[1] 、 ARGV[2] ,诸如此类)。例如

1 | 127.0.0.1:6379> eval "return {KEYS[1],KEYS[2],ARGV[1],ARGV[2]}" 2 key1 key2 first seco nd |

其中 “return {KEYS[1],KEYS[2],ARGV[1],ARGV[2]}” 是被求值的Lua脚本,数字2指定了键名参数的数量, key1和key2是键名参数,分别使用 KEYS[1] 和 KEYS[2] 访问,而最后的 first 和 second 则是附加参数,可以通过 ARGV[1] 和 ARGV[2] 访问它们。

在 Lua 脚本中,可以使用redis.call()函数来执行Redis命令

Jedis调用示例详见上面jedis连接示例:

注意,不要在Lua脚本中出现死循环和耗时的运算,否则redis会阻塞,将不接受其他的命令, 所以使用时要注意不能出现死循环、耗时的运算。redis是单进程、单线程执行脚本。管道不会阻塞redis。

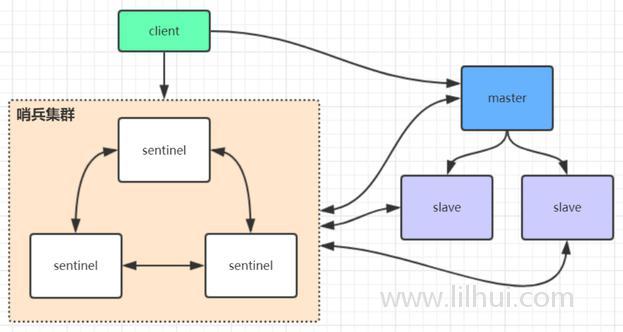

Redis哨兵高可用架构

sentinel哨兵是特殊的redis服务,不提供读写服务,主要用来监控redis实例节点。

哨兵架构下client端第一次从哨兵找出redis的主节点,后续就直接访问redis的主节点,不会每次都通过

sentinel代理访问redis的主节点,当redis的主节点发生变化,哨兵会第一时间感知到,并且将新的redis 主节点通知给client端(这里面redis的client端一般都实现了订阅功能,订阅sentinel发布的节点变动消息)

Redis 哨兵搭建步骤

1 | 1、复制一份sentinel.conf文件 |

sentinel集群都启动完毕后,会将哨兵集群的元数据信息写入所有sentinel的配置文件里去(追加在文件的 最下面),我们查看下如下配置文件sentinel-26379.conf,如下所示:

1 | sentinel known‐replica mymaster 192.168.0.60 6380 #代表redis主节点的从节点信息 |

当redis主节点如果挂了,哨兵集群会重新选举出新的redis主节点,同时会修改所有sentinel节点配置文件 的集群元数据信息,比如6379的redis如果挂了,假设选举出的新主节点是6380,则sentinel文件里的集 群元数据信息会变成如下所示:

1 | sentinel known‐replica mymaster 192.168.0.60 6379 #代表主节点的从节点信息 |

同时还会修改sentinel文件里之前配置的mymaster对应的6379端口,改为6380

1 | sentinel monitor mymaster 192.168.0.60 6380 2 |

当6379的redis实例再次启动时,哨兵集群根据集群元数据信息就可以将6379端口的redis节点作为从节点 加入集群。

哨兵的Jedis连接代码:

1 | public class JedisSentinelTest { |

哨兵的Spring Boot整合Redis连接代码见示例项目:redis-sentinel-cluster

1 | <dependency> |

springboot项目核心配置:

1 | server: |

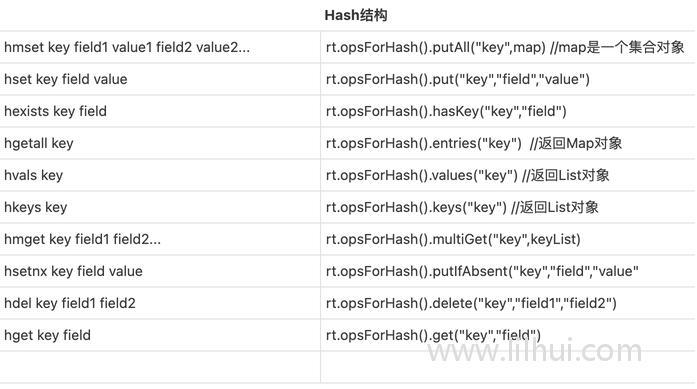

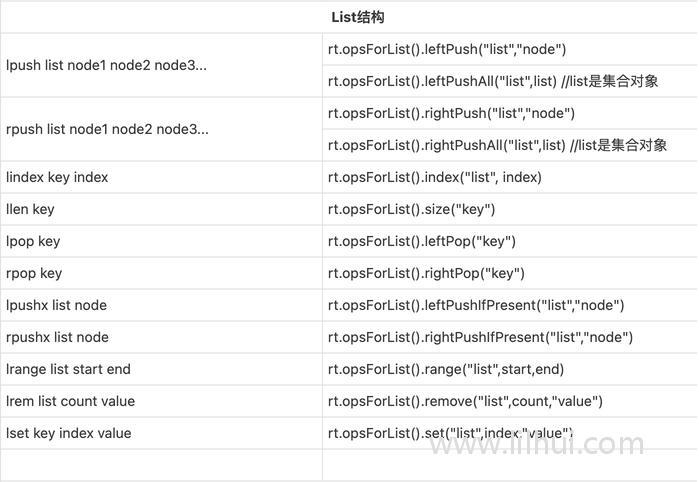

StringRedisTemplate与RedisTemplate详解

spring 封装了 RedisTemplate 对象来进行对redis的各种操作,它支持所有的 redis 原生的 api。在 RedisTemplate中提供了几个常用的接口方法的使用,分别是:

1 | private ValueOperations<K, V> valueOps; |

RedisTemplate中定义了对5种数据结构操作

1 | redisTemplate.opsForValue();//操作字符串 |

StringRedisTemplate继承自RedisTemplate,也一样拥有上面这些操作。 StringRedisTemplate默认采用的是String的序列化策略,保存的key和value都是采用此策略序列化保存 的。RedisTemplate默认采用的是JDK的序列化策略,保存的key和value都是采用此策略序列化保存的。

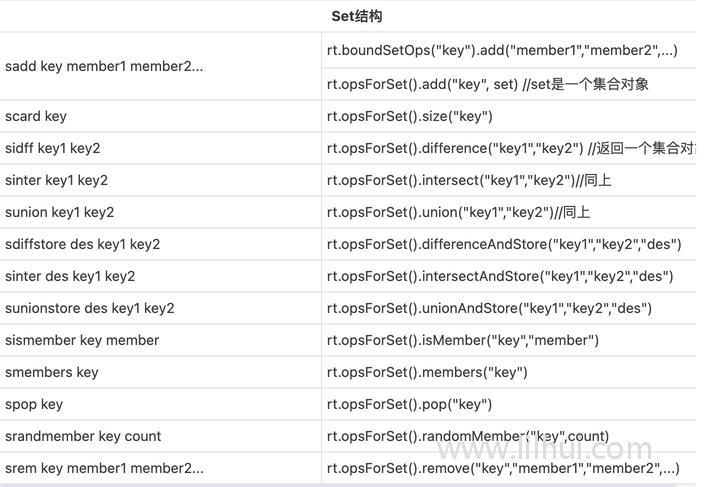

Redis客户端命令对应的RedisTemplate中的方法列表: